|

|

3 N4 ?3 E5 o2 c; s ~& j* x( s

3 N4 ?3 E5 o2 c; s ~& j* x( s

! `3 b8 W$ v) e8 @3 g' b1 I) }! C$ \

换了最新的基座模型,Agent 的表现却没有质的飞跃;反过来,给同一个模型加上持久化记忆、可复用的技能文档和标准化的工具接口,效果立竿见影——做过 Agent 工程的人,对这种「模型之外的东西比模型本身更重要」的体感多半不会陌生。但这个现象背后有没有一个统一的解释框架?上海交大团队的一篇 54 页综述给出了回答:外部化(Externalization)。

z: H2 F. y9 C' n近日,上海交通大学联合中山大学、上海创智学院、卡内基梅隆大学及 OPPO 等机构,于 2026 年 4 月 9 日在 arXiv 提交综述论文,首次以「外部化」为统一视角,系统梳理了 LLM Agent 的记忆、技能、协议与 Harness 工程四大支柱。核心观点:Agent 的实际进展,越来越取决于模型之外的外部认知基础设施,而非模型本身的能力提升。

9 J+ k7 b1 A+ J- z, |) \

0 } C) Z. o; J" k0 T

0 r, O+ Q s/ l) ~- n; l; ~1 E- _- |3 ?: `9 }

0 ]& i# ?; Q! T; R5 n8 ~% q# [

& I: Q5 n9 Q$ [ I

- 论文标题:Externalization in LLM Agents: A Unified Review of Memory, Skills, Protocols and Harness Engineering

, |' ~$ ^ J3 ?* b& x; V5 Q% c - 作者单位:上海交通大学、中山大学、上海创智学院、卡内基梅隆大学、OPPO

3 Q- p6 l9 _( _9 [ - 论文链接:https://arxiv.org/abs/2604.08224(2026 年 4 月 9 日提交)+ {' B" O6 r U

- 本文第一作者为上海交通大学博士生周宸宇。通讯作者包括 OPPO 研究院王俊博士,以及上海交通大学刘卫文、林江浩、张伟楠教授。

3 ~. p3 M0 z; U* G8 [+ X2 S# L2 D, C

0 S/ I5 q( \. g3 R/ e) {# q

- Y3 t$ D: i2 e3 [; M! ^1 f: o

- Y3 t$ D: i2 e3 [; M! ^1 f: o

" g$ L& @" c# i1 N! [% e$ Z0 @

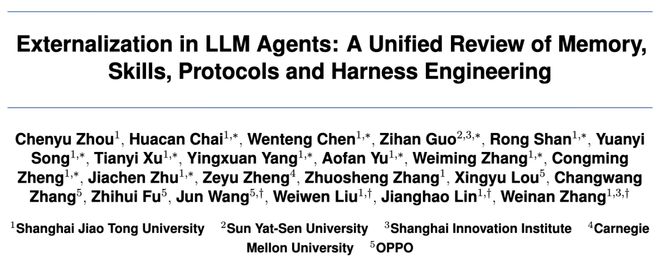

2 d5 Y2 P" G+ r7 @8 j; J) L& q- D! u图 1:外部化作为 LLM Agent 设计的组织原则。上方:人类认知外部化历史弧线;中间:LLM Agent 外部化弧线——记忆、技能、协议到 Harness;下方:文献全景图; [3 x) k: b/ ^+ J/ X8 g

模型已经很强,但 Agent 还是不够可靠

2 [* x4 g- u% p% j; L矛盾出在哪?

7 t _; S0 x- Y. a! M' {7 {9 G1 ^过去两年,大模型的参数规模和推理能力持续攀升。但熟悉 Agent 落地的工程师都有一个共同体验:换更强的基座模型,往往不如改进外部基础设施带来的提升显著。持久化记忆、可复用技能、标准化工具接口、沙箱约束、执行日志……这些「不属于模型」的东西,越来越决定着 Agent 能不能真正好用。9 N/ S- D8 }3 ~

论文把这个现象归结为三个结构性错配:

% v( G, B, p0 Q9 z, I

* S. w/ y8 N3 G9 o4 J" W" |+ ?2 l D' z1 U' F

- 连续性错配:上下文窗口有限且短暂,模型无法跨会话稳定保持状态。每次会话都是全新开始,之前积累的上下文需要从头重建。+ k- _- X+ V' h1 @8 f

- 一致性错配:复杂的多步骤流程往往被重新推导,而不是被稳定执行。同样的任务,不同时机调用,执行路径和质量难以保证一致。+ v: q F; R) g

- 协调性错配:与工具、服务和其他 Agent 的交互依赖临时约定,脆弱且不可移植。接口一旦变动,整条调用链路可能同步失效。& s* g' g. x$ Y

2 s1 L1 v: y8 `: B( z0 C论文借鉴认知科学家 Don Norman 的「认知工件(Cognitive Artifacts)」理论来解释这一现象。例如,购物清单不是扩展了人的记忆容量,而是把「回忆」问题变成了「识别」问题;地图不是让人导航变强,而是把空间关系从隐性变成可见。外部工件的力量,在于表征变换(Representational Transformation)——它重新组织了问题的形式,让主体用现有能力更可靠地解决它。. v1 J& |3 \0 N; `$ e

同样的逻辑正在 LLM Agent 上发生。论文的核心主张是:外部化才是理解近年 Agent 架构演进的统一逻辑,而不只是各种工程技巧的堆砌。, C- z6 W: Q0 c k9 V& G, a! y9 i

% s0 m' |5 L- j0 w

能力载体的三次外移 ) U/ q4 [9 l8 c/ C2 L

. t* D3 W) A0 h4 L+ S2 u7 o4 S* ~& D' _1 h

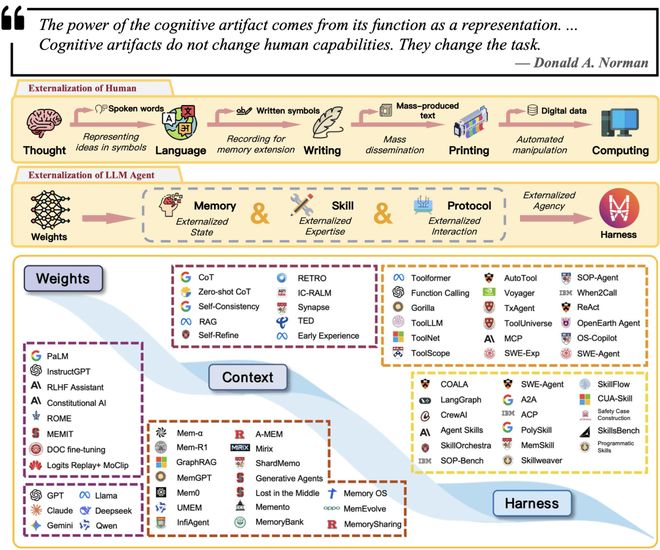

, B4 G6 v6 H' i图 2:社区主题在三个能力层上的演化(2022–2026)。关注重心从参数知识和提示工程,逐步外移到 Harness 层级的基础设施。: A7 b3 \. D/ F- _$ q l& S: \

权重层(2022–2023):能力几乎等同于模型参数,扩展定律主导叙事。奠定了基础,但知识难以选择性更新,行为难以审计,个性化几乎无从实现。

4 j& a# T5 O( {* }$ A上下文层(2023–2024):Prompt 工程、CoT、RAG 兴起,模型保持冻结,提示模板快速迭代。困难的「回忆」问题被部分转化为「识别」问题,但状态短暂,跨步骤协调始终脆弱。 g% _" X2 C7 L& b! W1 z' @

Harness 层(2024 至今):可靠性依赖外部记忆、工具注册、协议、沙箱与编排。「Agent 工程越来越体现为 Harness 工程」——OpenHands、SWE-agent、Deep Research 等皆遵循这一模式。( U S+ ], v: _2 ?

殊途同归:

8 ~; l: h, Y9 }# n7 b8 W' p记忆、技能、协议、Harness都是外部化

& Y. b9 @) S# \ A# F& k$ y回顾近年 Agent 领域的技术进展,记忆系统、技能系统、协议标准化,乃至 Harness 工程本身,看似四条独立的研究路线,各自解决不同的问题。但论文指出,它们本质上做的是同一件事——将特定层面的认知负担从模型内部迁移到外部结构中。这不是巧合,而是 Agent 走向可靠部署的必然收敛。四条路线的交汇点,正是外部化。

5 l+ L' O& T/ `- R记忆外部化状态,将「回忆」转化为「检索」,解决连续性错配;技能外部化专业知识,将「即兴生成」转化为「组合复用」,解决一致性错配;协议外部化交互结构,将「临时约定」转化为「结构化契约」,解决协调性错配。而 Harness 外部化的是更根本的东西——Agent 的认知环境本身:原本隐含在每次模型调用过程里的执行流、沙箱、观测、权限,都被显式地抽出来,成为可检视、可配置、可治理的基础设施。

3 @6 R% b3 o( I4 E+ ?记忆:外部化的状态7 D" l$ K7 W' K% {

/ F2 M4 ]% F0 b+ a) v

/ F2 M4 ]% F0 b+ a) v

/ b0 ^( J6 b# F

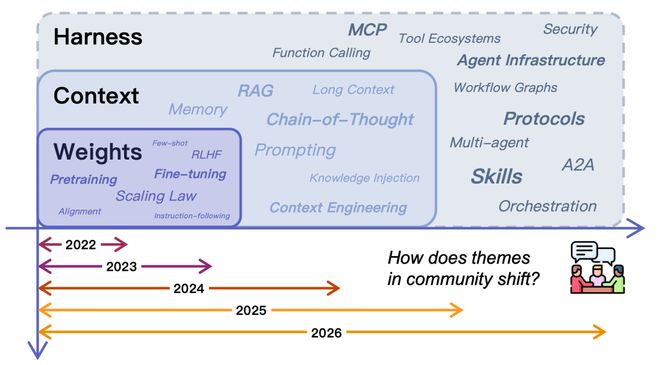

% X7 \# ?" V! W! N图 3:记忆作为外部化状态的全流程——从原始上下文到四层记忆内容,经由记忆系统架构(单体式→分层编排→自适应),最终与 Harness 集成。

! C/ |5 e. p( g8 x4 o2 S论文将 Agent 记忆组织为四个层次:工作上下文(当前任务状态、打开的文件、部分完成的计划)、情景经验(过去的运行记录和失败轨迹)、语义知识(领域事实、用户偏好、通用启发)和个性化记忆(特定用户的习惯与约束)。- X! I9 I, ~+ e

记忆架构随需求而演进:从将全部历史塞入提示的单体式,到主动状态加外部存储的检索式,再到按语义或时序分层编排的分层架构,最终走向基于反馈动态调整检索策略的自适应记忆系统。核心效果始终是同一个:模型不再需要从权重中「回忆」,而是从持久化存储中「检索」。0 f! I! ~ p, Z/ W' z

技能:外部化的专业知识' a5 ?/ [# s& N9 @( T* A

1 F4 {. o. K1 u$ q4 y

1 F4 {. o. K1 u$ q4 y

$ c3 M& z8 j! m f

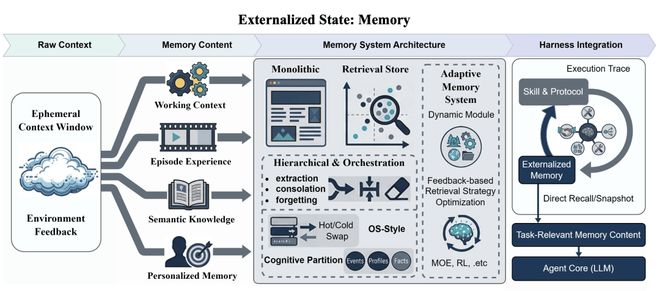

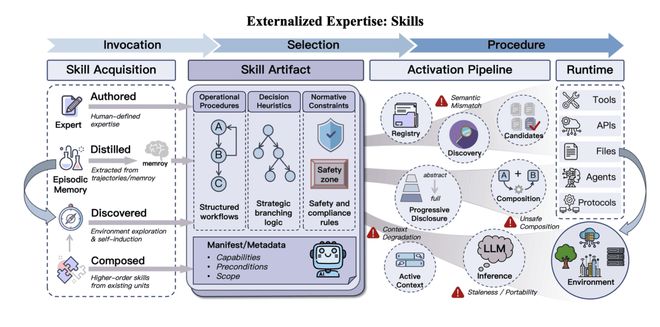

9 U3 w. \: t9 F3 r图 4:技能作为外部化专业知识的全流程——从获取(人工编写、蒸馏、发现、组合)到技能工件,经由激活管线(注册、渐进披露、组合),最终绑定到运行时。

" ]$ \. O& L% d4 ]! b: A1 I4 X1 a- U技能系统将可复用的程序性专业知识打包为显式工件。一个完整的技能包含三个组成部分:操作程序(任务骨架和分解步骤)、决策启发(分支决策的局部策略)、规范约束(合规、安全和操作边界)。0 x6 _$ h) i0 b2 W) W* a

技能有四条生成路径:人工编写(专家手工编写 SKILL.md 等指令文件)、轨迹蒸馏(从历史运行记录中提取可复用程序)、自主发现(Agent 在环境中探索并归纳,如 Voyager)、组合构建(由已有低层技能组装高阶能力)。技能从「发现」到「执行」经过注册、渐进式披露(按需从摘要扩展到完整细节)、组合等阶段,最终在运行时绑定到具体工具、API 和协议。, F, t, ^5 A$ T% M) Y

核心效果:模型不再需要每次从零「即兴生成」工作流,而是从预验证的组件中「组合」。- _! d/ c( s$ I$ p+ K

协议:外部化的交互结构( a, z' x4 y/ X" t5 j

; N* D/ y, C/ p- E& ~& o* G7 i/ K) V

/ J9 J- m! l4 O; I6 N& ?4 O4 B9 q' K7 Y% h

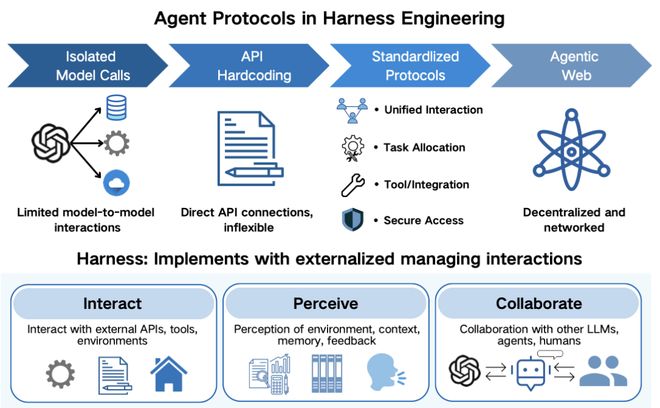

图 5:协议在 Harness 工程中的演进——从孤立模型调用到标准化协议再到去中心化 Agentic Web。Harness 通过协议管理三类交互:与工具交互、感知环境、与 Agent 和人类协作。

+ G2 F$ W+ x8 D, p+ o# {7 j协议将交互结构固定为机器可读的契约,外部化了四类负担:调用语法(参数格式与类型)、生命周期语义(状态转换与完成条件)、权限与信任边界(授权规则)、以及发现元数据(可用能力的声明)。

# G3 C3 c( v( T0 O, {论文梳理了三类主要协议族:( s( v- s: H E8 H1 w& j

+ w. y3 W- b( B- z

- J8 |2 y( e+ C2 d/ p" x- Agent-Tool 协议(如 MCP):通过 JSON-RPC 标准化工具发现与调用,使工具可以动态注册、模块化扩展。* L, }. Y# f( E. K0 E! j, i

- Agent-Agent 协议(如 A2A):定义任务委托、进度交换和能力发现的结构化语义,支持开放 Agent 生态的互操作。

7 {5 S6 _, U8 h! E; B0 ?! S - Agent-User 协议(如 AG-UI):以类型化执行事件和状态流的形式使运行时可观测、可移植,让用户界面能够实时跟踪 Agent 行为。

" k3 g/ I1 l7 B2 w) O: r

2 I. Y6 O1 r* K0 q% z- w核心效果:临时约定变为结构化契约,跨系统协调从脆弱变得可治理。

, V4 ~/ H6 ?' O9 H3 Y# xHarness:统一的认知环境$ ~" d2 o' ~9 j5 t+ O& X2 ]

! O6 V# ~- r% R4 H# f# e3 m3 L

! O6 V# ~- r% R4 H# f# e3 m3 L

1 ]- t8 a0 Y; N: m- c; Q

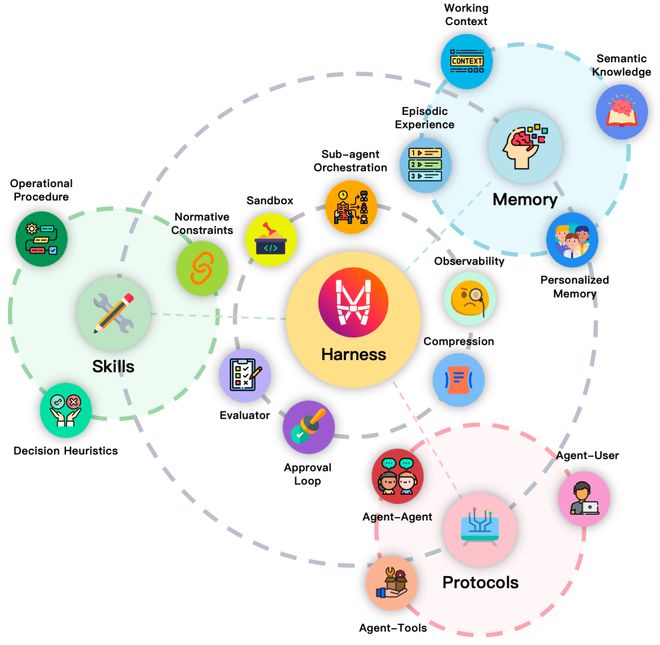

5 t, y9 S# q2 j$ E图 6:外部化 Agent 的整体架构。Harness 居于中心,Memory、Skills、Protocols 三大外部化维度环绕其外,沙箱、可观测性、压缩、评估、审批回路等操作元素在中间层协调运作。$ B9 P' n; M5 D+ H

Harness 外部化的是前三者赖以运行的认知环境本身。原本隐含在每次模型调用过程里的执行流、沙箱、观测、权限,被显式地抽出来,成为可检视、可配置、可治理的基础设施——这既是容纳记忆、技能、协议的运行时,也是让整套系统从「黑箱」变成「白箱」的关键。论文从六个设计维度分析其构成:0 G/ e [6 g6 q0 k3 ~* ^

1 A& e/ E2 k2 K& g; M1 i$ O8 N& u: a2 G

- Agent 循环与控制流— 感知-检索-规划-执行-观察的完整周期,管控终止条件、递归边界和资源消耗- \8 M3 W @5 G- d8 Q( M6 u

- 沙箱与执行隔离— 文件系统隔离、网络限制、云端沙箱,既是安全边界,也是认知边界

* _3 u$ P# Y% V. q! c - 人类监督与审批门控— 执行前审批、执行后审查和升级触发,自主性作为可配置参数3 Y; p# F5 b5 A$ W4 x' Q

- 可观测性与结构化反馈— 工具调用的结构化日志、连接动作与前因的执行溯源,支持调试、审计和内部反馈回路

1 S2 n! E8 k& t- C8 s* y - 配置、权限与策略编码— 用户、项目、组织三级分层约束,以声明式规则在运行时强制执行+ m3 i& B7 B T# Y" M/ D

- 上下文预算管理— 历史摘要、优先级驱动的内容淘汰、技能分阶加载,平衡三大维度对窗口的竞争. o' K3 T" K T

4 ~3 y6 t4 |1 k三大维度在 Harness 内部形成自我强化的循环:记忆经验蒸馏为技能,技能执行轨迹沉淀回记忆;协议规范了技能的调用方式,也将结构化结果写入持久状态;更丰富的记忆带来更好的技能,更好的技能产生更丰富的执行轨迹,依次循环。% E& c* v6 D4 \ b6 w1 U; c! y. b

一个场景:不换模型,只改「外部环境」 " H" c8 y7 s5 m" x$ P! s4 J* U

让一个软件工程 Agent 在大型代码仓库里实现新功能、运行测试、提交 PR——论文用这个例子直接说明了外部化的意义。

# M2 G5 Z+ D/ p ^% q4 d

( j3 w+ p+ h( J9 Q

$ z# z8 G; U/ U$ v t- a* v- 没有外部化时。模型需要把仓库结构、项目约定、工作流状态和工具交互全部塞进一个脆弱的提示窗口。任何一处出错,整个流程需要重来。随着任务复杂度增加,提示模板的管理成本以超线性速度上升。; f$ ]9 n, Y( B' `

- 有了外部化之后。持久化的项目记忆提供跨会话上下文;可复用的技能文档编码项目约定和工作流;协议化的工具接口确保调用格式始终正确;Harness 负责步骤排序、输出验证和失败恢复。: t+ h6 K3 l9 P" n. C

% Z+ K1 n7 M7 N# g

基座模型可以完全不变,改变的是它所面对任务的表示方式。这也是整篇论文的核心论点:Agent 可靠性的提升,越来越不来自更强的推理器,而来自被更好地组织起来的认知系统。衡量一个 Agent 系统的问题,也从「模型有多强?」变成了「哪些负担已经被外部化,让模型不再需要每次从头解决?」

p, X( ?) s0 K% b3 }' y; }未来方向

; }' \# t/ v- Z0 N论文最后指出了六个前沿方向:1 |( ~ a. S, U, i

+ `3 b( d& v. G$ e* b' {8 r

+ {% O$ w2 n& {0 i& S- 外部化边界的扩展— 规划目标、验证逻辑、编排策略本身都在成为 Harness 对象,而非只是被 Harness 执行的内容* E0 W- x/ o1 K& j

- 从数字到具身— 具身 Agent 正在经历相同的外部化模式。高层规划器与低延迟执行模块的分离,正是外部化逻辑在物理系统中的映射+ N- {6 d h" ?( V. v

- 自演化 Harness— 通过强化学习、程序合成或模仿学习让基础设施自动更新,前景广阔,但治理风险同步放大

! ?! u2 X( O4 {% h& N - 安全与治理— 记忆投毒、恶意技能注入、协议欺骗等新型攻击面值得专门关注,强制审查门控与来源溯源是成熟系统的必要保障9 b8 ?$ C$ m% q/ s$ ]2 P |4 X3 B

- 共享基设与多智能体生态— 当记忆、技能、协议可以跨 Agent 共享,集体学习和劳动分工成为可能,同时带来基础设施漂移等治理难题

# a2 a& g# |6 ?: b b1 b" M8 n! V - 外部化的评估— 现有 Benchmark 对基础设施贡献的度量严重不足,可迁移性、可维护性、上下文效率等新维度有待建立

w( u5 p1 ~: c5 p

( r; l' }. {, x

从记忆到技能到协议再到 Harness,这篇综述的价值不在于罗列技术细节,而在于提供了一个系统级的解释框架。一句话概括:更好的 Agent 不只是更好的推理器,而是被更好地组织起来的认知系统。 |

|