|

|

在视觉生成领域,从图像生成到视频生成,研究的核心问题正逐渐从“能否生成内容”转向“能否生成可控且结构正确的内容”。/ N' ]' J; b# z5 N

尤其是在人物动画生成任务中,研究人员不仅希望模型能够生成具有真实感的画面,还希望生成过程能够受到精确控制,例如通过输入人物图像与动作姿态序列,使模型自动生成连续的人物动画。在这一方向上,姿态驱动的人物图像动画已经取得了显著进展。然而,这些方法大多集中于单人物场景,当生成对象扩展到多人物时,问题的复杂度会显著增加。$ ^2 s+ H- h( f8 ^" B# U

而在在多人物动画生成过程中,模型不仅需要保持每个人物外观的稳定性,还必须在动态过程中正确建立人物与动作之间的对应关系,并处理人物之间的空间交互。如果模型无法持续区分不同人物,生成结果就容易出现身份混淆、动作错位或空间关系不合理等问题。因此,如何在复杂互动过程中保持人物身份一致,并同时建模多人物之间的空间关系,已经成为多人物视频生成研究中的关键挑战。; S3 w8 @- W+ r/ i; c( y: v8 S

在这样的研究背景下,来自中国科学院计算技术研究所与上海交通大学等机构的研究团队提出了一种新的多人物动画生成框架,并发表了题为《MultiAnimate: Pose-Guided Image Animation Made Extensible》的研究工作。这项研究通过引入人物身份标识机制以及基于人物掩码的空间关系建模方法,使生成模型能够在多人物互动过程中持续区分不同个体,并保持人物外观与动作的一致性。

4 |3 t8 {: w+ G) d! F% L值得注意的是,这个方法在训练阶段只使用双人数据,却能够在推理阶段扩展到三人甚至更多人物的动画生成任务,为多人物视频生成提供了一种具有良好扩展性的解决思路。, _8 ], Z" b. I! `" Z

) }* @2 f. _: E$ |! J1 X% J1 U% G

) }* @2 f. _: E$ |! J1 X% J1 U% G

& o4 C3 w+ a* A. F从双人到多人:模型生成能力的验证

( p) a9 R! V3 u# M/ J" |& |从实验的整体来看,MultiAnimate 在多人物动画生成任务中明显优于现有方法,并且具有很强的扩展能力和泛化能力。

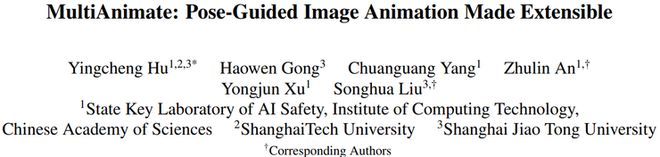

0 R# I" g0 Z! ~; s: ]4 S研究人员首先在 Swing Dance 数据集上测试模型性能。这个数据集包含大量双人舞蹈视频,人物之间的互动非常复杂,例如旋转、交换位置以及身体接触等。实验结果显示,MultiAnimate 生成的视频在视觉上更加真实,人物动作与输入姿态更加一致,视频帧之间的连续性更好,同时人物身份保持更加稳定。3 l$ Y' I: c3 e# ~6 I" P! D1 P. F

相比之下,其他方法在复杂交互场景中容易出现多种问题。例如,当两个人旋转或靠近时,模型容易出现身份混乱的现象,人物外观可能被混淆,甚至出现衣服突然交换的情况。当两个人互相遮挡时,一些模型会产生遮挡错误,导致身体部位生成不正确,例如手臂位置异常。雷峰网

' d$ g5 ]9 ?3 ^1 F) Y) N此外,在复杂动作过程中,一些方法还会导致背景质量下降,出现背景模糊或者抖动的现象。而 MultiAnimate 在整个视频生成过程中能够保持每个人的外观一致,动作顺序合理,人物之间的空间关系稳定,这说明该方法在理解多人物空间关系方面具有更强的能力。8 V6 o# c! {- n: |

* ]' r8 k# p3 U( a! G! x! z

* ]' r8 k# p3 U( a! G! x! z

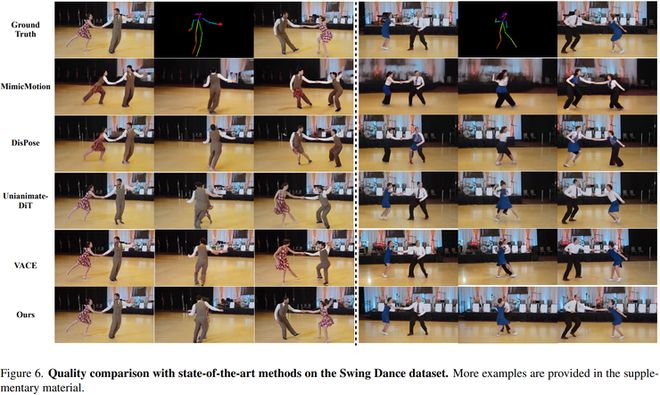

' ^. h: b% L& L1 m5 ]' H研究团队还在 Gen-dataset 上对模型进行了测试。这个数据集由视频生成模型自动生成,包含两人或三人场景,并且具有不同背景环境和不同动作组合。实验结果表明,即使模型没有专门在该数据集上进行训练,仍然能够生成质量较高的视频。8 c' \0 U/ T) F- ^; z; d

具体表现为动作控制准确,人物外观保持一致,并且视频在时间维度上具有良好的连续性。不过研究人员也发现,由于场景更加复杂,在某些视觉感知指标上优势略小,这说明模型在更加复杂环境中的表现仍然存在进一步提升的空间。1 C- w% O- l3 W

3 i S: L3 R4 z( W' f; \ O

* W1 i0 R$ k, a+ M8 d# s& J在泛化能力测试中,研究团队使用来自社交媒体的视频作为测试数据,这些视频包含三人舞蹈、四人舞蹈以及最多七人同时参与的舞蹈场景。这些数据完全没有参与模型训练。) c+ U; L. u- ^, s. U" x6 j6 G

实验结果发现,即使模型只使用两个人的视频进行训练,仍然能够生成三人动画以及更多人物参与的互动动画,并且可以正确区分不同人物,保持每个人物的身份一致,同时能够正确生成多人物之间的空间关系。这说明模型具有很强的扩展能力,也意味着训练人数与最终生成人数并不完全一致,模型能够推广到更加复杂的多人物场景。

3 u$ n4 o+ E) G( p; N; m

. ^' {5 b# h! g" P5 s# i* v, v* T' D

+ Z- Q `, d x/ P( E此外,研究还展示了大量生成视频的画面对比结果。可视化分析发现,一些已有方法例如 MimicMotion 和 DisPose 在动画生成初期就可能出现人物身份混乱的情况,例如人物衣服颜色突然发生变化,或者两个角色在交换位置之后身份发生混淆。" \2 @) G( p# `( _ k5 J

还有一些方法例如 UniAnimate-DiT 和 VACE 在简单动作阶段表现较好,但在复杂的人物互动之后仍然容易出现身份交换以及遮挡错误等问题。相比之下,MultiAnimate 在整个视频生成过程中都能够保持人物身份稳定,动作生成合理,并且人物之间的空间关系正确,因此在视觉效果上明显优于其他方法。6 \& Q6 C& b1 Q T& ^

MultiAnimate 的构建与验证路径

5 _/ e9 V# i. t1 `( W& H为了得到上述实验结果,研究人员先是于数据准备阶段,在实验中使用了三类数据。第一类是 Swing Dance 数据集,这是一个双人舞蹈视频数据集,总时长约为 30 小时,包含 680 对舞者。雷峰网

# ^3 k( ~) k; {2 b; [1 i4 L" O数据中存在大量旋转动作、人物互动动作以及频繁的人物遮挡现象,因此非常适合用于训练模型理解多人物之间的空间关系。在训练过程中,模型通过这些视频学习两个人如何进行互动,如何在动作过程中保持人物身份一致,以及在人物相互遮挡时如何正确处理空间关系。

( x5 q% N4 Y- ?& U u6 k6 U第二类数据是 Gen-dataset 数据集,研究团队利用视频生成模型 Wan2.2 自动生成了 2079 个视频,每个视频长度约为 5 秒。这些视频包含两人或三人的场景,并具有不同的背景环境和不同的动作组合。使用这一数据集的目的主要有两个,一是增加训练场景的多样性,二是提高模型的泛化能力。

+ r$ n/ e$ N) _$ E/ {第三类数据来自社交媒体平台 TikTok 的舞蹈视频,这些视频中通常包含三到七个人同时跳舞,动作复杂且场景多样。这部分数据只用于测试模型性能,并不参与训练,主要用于验证模型是否能够推广到更多人物的场景。

0 r) ` }- \; f# b1 T

! L T W( n7 z7 _& _" O3 A1 J: m& _$ b

在模型训练之前,研究人员还对视频数据进行了预处理。预处理主要包括两个步骤。第一步是姿态提取,研究人员使用人体姿态检测模型提取人物的骨架信息,这些骨架信息可以表示人物的手臂位置、腿部位置以及整体身体姿态。6 [* E# A) s6 t5 T. s5 Z$ e! C

通过这些骨架序列,模型能够根据姿态信息驱动人物动作生成。第二步是人物掩码提取,研究人员使用视频分割方法生成每个人物的追踪掩码。掩码能够表示在每一帧图像中哪些像素属于人物 A,哪些像素属于人物 B,从而使模型能够区分不同的人物。

5 P1 y) j: D* ]3 Z

8 O/ U2 t; w4 V' c {0 Y+ y5 j, [& `, b% H8 t( e, \% }

模型训练过程分为两个阶段。在第一阶段训练中,研究人员使用 Swing Dance 数据集对模型进行训练,训练目标是让模型学习双人之间的互动关系。训练设置为大约 40 个训练周期,总训练步数约为 7000 步,每个GPU的 batch size 为 1,训练过程中使用两张 A100 GPU。在这一阶段训练完成后,模型最多可以支持三个人的动画生成。

3 H# p+ y3 `* z$ q3 G第二阶段训练是在第一阶段的基础上继续进行,研究人员加入 Gen-dataset 数据集进行训练,其主要目的是提高模型对不同场景环境的适应能力。第二阶段训练约进行 3 个周期,总训练步数约为 2400 步。除此之外,研究团队还训练了一个扩展版本模型,这一模型可以支持最多七个人的动画生成。扩展模型仍然使用双人数据进行训练,但通过新的训练策略使模型能够学习区分更多人物,该模型训练了 24 个周期。# Q- I) e3 n4 s* p

在对比实验中,研究人员将 MultiAnimate 与多个已有模型进行了比较,包括 UniAnimate-DiT、MimicMotion、DisPose 和 VACE。实验主要比较视频质量、动作生成的准确性、人物身份一致性以及视频时间连续性等方面。实验结果显示,MultiAnimate 在几乎所有指标上都优于这些方法。$ A$ o% C. O( g8 h B# }

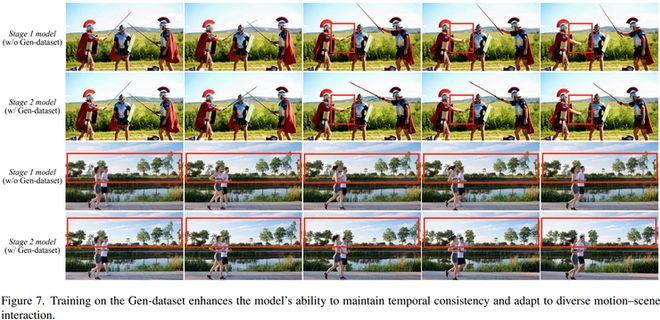

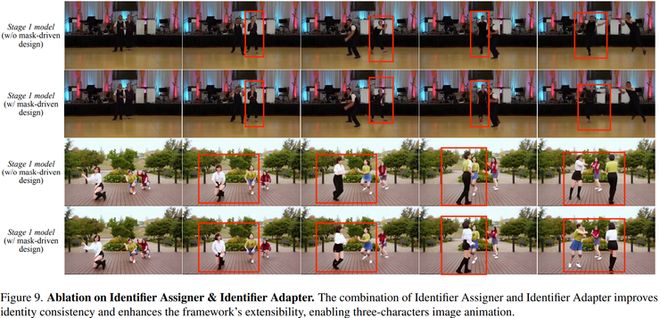

此外,研究团队还进行了消融实验,用于验证各个模块设计是否有效。消融实验主要测试了两种设计。第一种是基于人物掩码的 Mask-driven 设计,如果去掉这一设计,模型在生成视频时容易出现人物身份混乱以及空间关系错误的问题。( x* e9 p( V* A; U- ^/ z

实验结果说明,掩码设计能够帮助模型更好地理解人物之间的位置关系。第二种是 Identifier 模块设计,其中包括 Identifier Assigner 和 Identifier Adapter 两个模块,这两个模块的作用是为每个人物分配唯一的身份标识。如果去掉这两个模块,模型在多人物场景中容易出现身份交换和动作混乱的现象。实验结果表明,这两个模块能够显著提升模型在多人物动画生成中的稳定性。

3 d& q9 g$ W# r

) x1 @8 V% M* M4 ~

) x1 @8 V% M* M4 ~

T7 M% H) F1 d突破多人物动画生成的关键瓶颈# t# S5 D0 f; T0 V: N5 r0 N6 O

总的来说,这项研究的实验意义主要体现在三个方面。首先,在多人物动画生成任务中,传统方法大多只针对单人物动画进行研究,当场景中出现多人时,模型往往容易出现身份混乱、动作错误以及空间关系不正确等问题。针对这一情况,研究团队提出了 MultiAnimate 方法,通过身份标识机制、人物掩码以及空间关系建模,使模型能够在生成视频时正确区分不同人物,并保持人物之间的空间关系,从而提升了多人物动画生成的稳定性和准确性。

, j6 G5 o/ Y) G- w其次,在人物数量的扩展能力方面,传统方法通常需要按照固定人数进行训练,例如两人模型只能生成两人动画,如果需要生成更多人物的动画,就需要重新收集数据并重新训练模型。而在这一研究中,研究人员发现,只使用两人数据进行训练,模型仍然可以生成三人甚至更多人物参与的动画,这说明模型在多人物场景中的扩展能力得到了明显提升。

3 z2 |2 r* u$ t3 V4 |$ w, K最后,在数据利用效率方面,收集包含多人物互动的视频数据往往成本较高,因此获取大规模多人物数据集比较困难。研究结果表明,只需要少量双人数据,就能够训练出支持多人物动画生成的模型,这在实际应用中具有重要价值。$ E: b2 y; w6 }: [3 N8 I

MultiAnimate 背后的科研工作者6 U9 B5 o# y6 W' G7 n% y$ G8 v

论文的通讯作者为安竹林,现为中国科学院计算技术研究所的副研究员,同时也是博士生导师,长期从事人工智能和计算机视觉相关研究工作。他在中国科学院获得博士学位后,一直在该研究机构从事科研与人才培养工作。. z: `& {# T" X- w; l

研究方向方面,安竹林的研究主要集中在神经网络加速和计算机视觉两个领域。他的研究关注如何提高深度学习模型的效率,以及如何将深度学习技术应用到视觉理解和视觉生成任务中,例如图像识别、视频分析以及视觉模型优化等问题。6 a+ ], m; x9 I& T3 A* j

在研究成果方面,安竹林及其研究团队围绕深度学习模型效率和视觉任务展开了多项研究。另一些研究则关注视觉任务中的模型设计与性能提升,通过改进算法方法来提高图像识别或视觉理解的效果。这些研究不仅推动了计算机视觉技术的发展,也为深度学习模型在实际场景中的应用提供了重要技术基础。1 \ n* z- X! \) V3 t2 G: C( ]

6 a2 b1 b6 C' k8 J

6 a2 b1 b6 C' k8 J

k( `& j0 z3 Z' R! x

参考链接:https://oldoc.github.io/

! ]% _& M+ ~1 O2 M$ B论文的另一位通讯作者为刘松华,目前任职于上海交通大学人工智能学院,担任助理教授,主要从事计算机视觉与人工智能相关研究。在进入高校任教之前,他曾在新加坡国立大学完成博士学位,研究方向集中在深度学习与视觉生成等领域。6 d$ o5 D5 P+ O( C

在研究方向方面,刘松华的工作主要集中在计算机视觉和机器学习领域,重点关注视觉生成模型、数据蒸馏、模型适配以及深度学习模型效率提升等问题。这些研究内容主要围绕如何提高生成模型的质量、效率以及在实际场景中的应用能力展开。

8 R8 p, n9 `& S5 h2 Y6 n/ J在学术成果方面,他在人工智能和计算机视觉领域发表了多篇学术论文,相关研究成果被多个国际重要学术会议收录。同时,他还参与提出了多种视觉生成与图像处理方法,例如利用神经网络自动生成绘画笔触的绘画生成方法,以及通过改进注意力机制提升图像风格迁移效果的方法。这些研究成果在图像生成、艺术风格迁移以及视觉内容生成等方向具有一定影响。

5 H0 M$ a& s& { B* Z, Y4 v& A

8 x( `2 j, _3 T; Q' [

8 x( `2 j, _3 T; Q' [

* N5 i6 a, `4 K, r& B# p C参考链接: https://huage001.github.io/ |

|