|

|

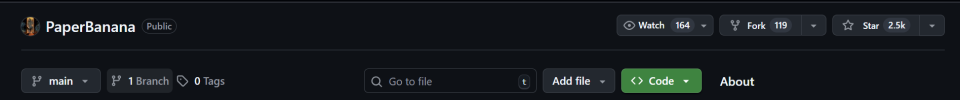

做科研的兄弟们都知道,写论文最痛苦的环节往往不是敲代码,而是画图。

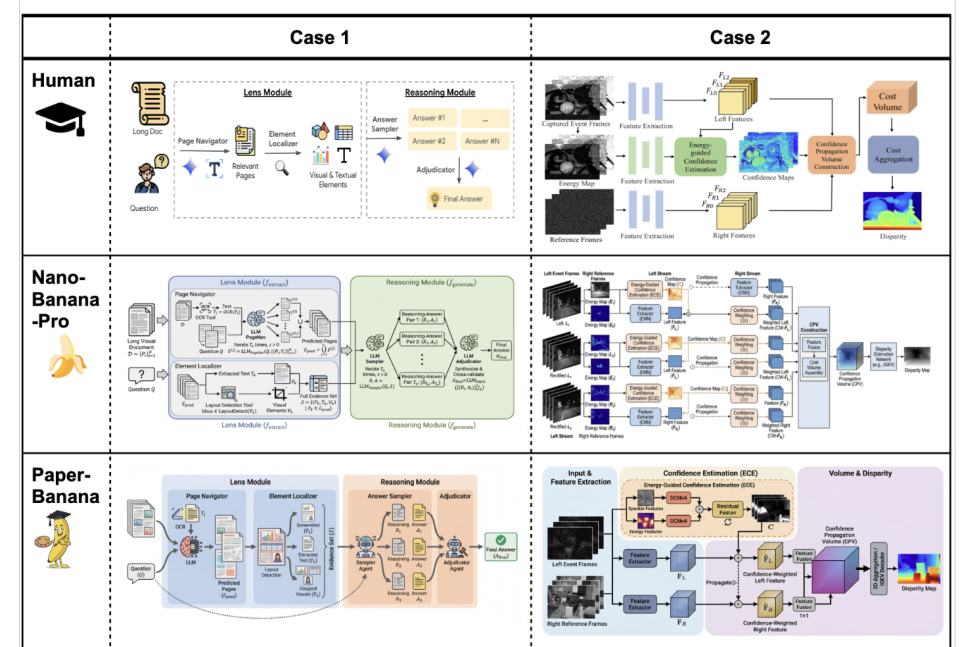

" a' ~4 M5 o. l A为了画一张这就“高大上”的Methodology(方法论)架构图,你可能要在 Visio、PowerPoint、甚至 Adobe Illustrator 之间反复横跳。- |/ h, I+ W4 @$ D

配色要高级,线条要对齐,逻辑要清晰——往往一整天过去了,图还没改好,心态先崩了。

- f J) z- J" x) @$ k最近,北大(PKU)联合 Google Research 推出的一个名为 PaperBanana 的项目在 GitHub 上还未开源就收获了2.9k的关注。$ ]5 B7 [ X% a0 k

对,还没开源,官方说还有2周~好饭不怕晚,我们再等等!* c* q$ d9 C. b1 L2 Z* ?

对,还没开源,官方说还有2周~好饭不怕晚,我们再等等!* c* q$ d9 C. b1 L2 Z* ?

官方号称它是一个智能体框架,能直接把你的文字描述转化成 出版级的学术插图!, o$ q' Y( D9 [; G3 X

PaperBanana怎么做到的?2 {; V* j( T& `: m" ^+ U

PaperBanana怎么做到的?2 {; V* j( T& `: m" ^+ U

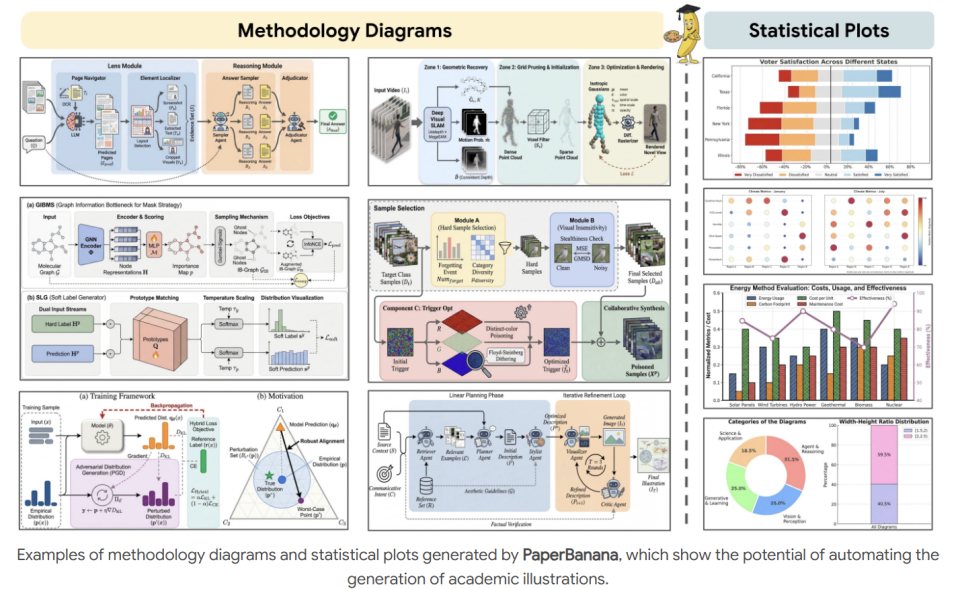

PaperBanana的解法,五个智能体协作% s+ u! p2 l7 E" \) _4 k

PaperBanana的核心思想很简单,用AI智能体来完成论文配图的全流程。3 p6 c- L6 L7 e! a/ G" F1 q

但它不是简单地"给个prompt就生成图片",而是设计了五个专门的智能体,各司其职:

但它不是简单地"给个prompt就生成图片",而是设计了五个专门的智能体,各司其职:

, X! B* e9 F2 x+ RRetriever Agent(检索者) :先去搜相关的参考图

- V2 G" E! D+ x$ Z画图之前,得先看看别人怎么画同类方法的。比如你做的是Transformer变体,它就去搜NeurIPS、ICML这些顶会里类似的方法图,作为参考。

! s# Z. u# `2 y* b) m! oPlanner Agent(规划者) :把你的方法转换成详细的文字描述

( i4 H; }/ B2 M这是整个框架的"大脑"。它需要读懂你的论文正文、图表说明,然后规划出一套详细的画图方案:这里要画几个框?用什么颜色?标签怎么写?

7 R) K4 d' ^# A3 H% p7 o4 c. r这个过程其实是在做"视觉化思考"——把抽象的方法变成具体的画面描述。这个过程本身就有价值,因为你在思考"怎么表达"的时候,其实也在梳理自己的思路。" K0 j" s" G- Y: I

Stylist Agent(风格师) :确保符合学术审美# L0 x" h" [7 d8 E' b# P H

它会从检索到的参考图里提取风格规则:用什么配色方案?字体用多大?间距怎么控制?阴影怎么加?: ?3 E! U/ ]. Y

这些细节决定了图表最终的专业感。 [9 c5 N! Y e) P. q! H! X3 ]

Visualizer Agent(视觉化者) :把描述变成图片或代码- w! G# a" t R; A

这是执行层。根据前面的规划,要么直接生成图片,要么生成代码(比如Matplotlib、Plotly的代码)。

& ^; `3 @* k! ~6 QCritic Agent(批评者) :自我检查和迭代) ?4 l8 T) t7 t# G6 h. J) K. ~$ d# \

生成完不等于结束。Critic会检查:这个图准确吗?简洁吗?美观吗?如果不行,就反馈给前面的智能体重新做。

" m6 X( v, [# V& E这五个智能体串起来,就是一个完整的"思考-规划-执行-检查"闭环。

6 N4 h" ]# {. r: S0 h/ o: J怎么评估好不好?

! j5 \( G( o Z( [& T很多论文会说"我们的方法很好",但没有量化指标。$ ?, w0 ~- c: w9 w% A

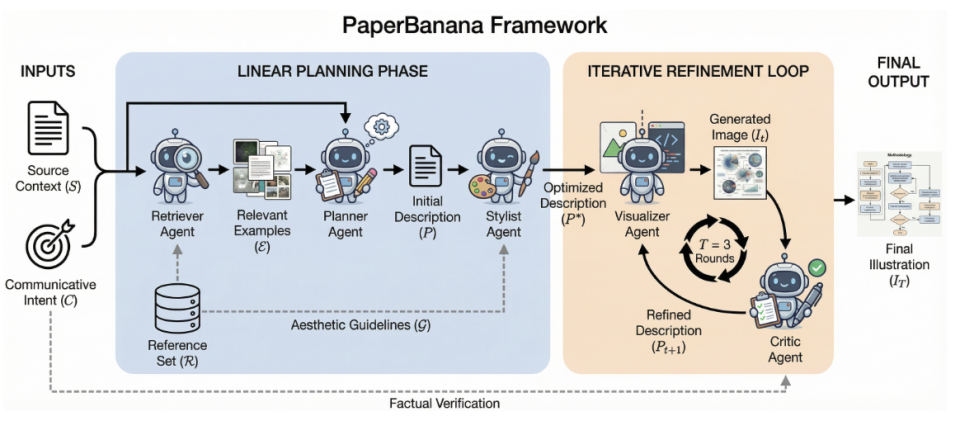

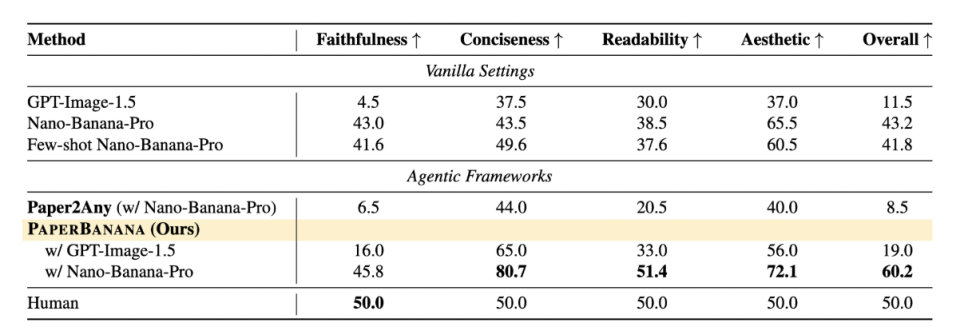

PaperBanana团队做了一个很重要的事情:建了一个评测基准,叫PaperBananaBench。

: h6 a6 Q7 j) V( t( D/ ?2 y- u他们从NeurIPS 2025的论文里,手工筛选了292个真实的方法论图作为测试集。覆盖了计算机视觉、NLP、强化学习等不同领域,也包括了不同风格的图表。5 e! `, {( D4 k$ K4 q" V9 n

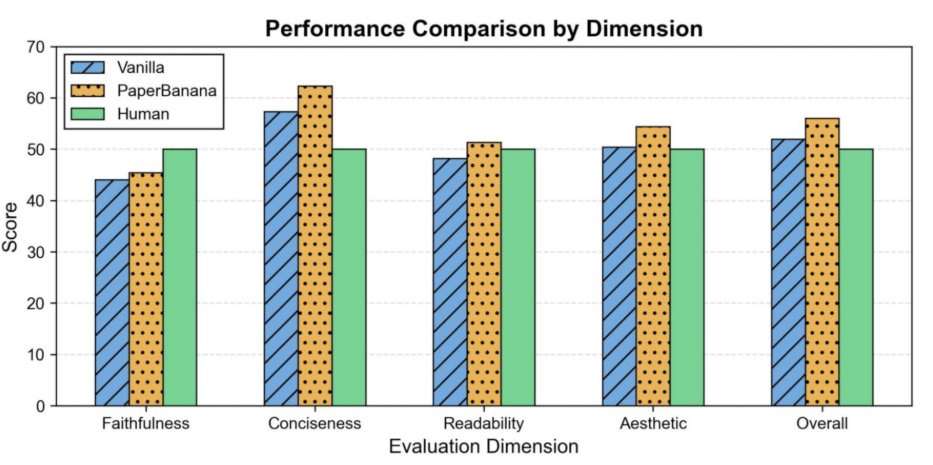

结果显示,PaperBanana在这四个维度上都显著优于基线方法。

结果显示,PaperBanana在这四个维度上都显著优于基线方法。

- a' i4 a9 H" w; |2 R5 t这个数据还挺猛的。我原本以为提升也就10-20%,没想到是全面领先。

5 q' U" Y, V; i& n. g+ O2 z- p+ Z

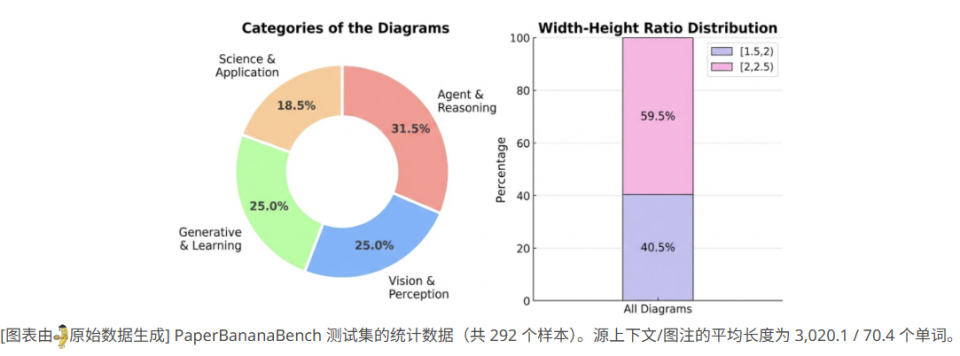

更重要的是,他们不只是画方法图,还能画统计图表(比如柱状图、折线图)。下面这个柱状图就是官方给的例子6 c$ Q" M# m3 d, k* F& y) ?

更重要的是,他们不只是画方法图,还能画统计图表(比如柱状图、折线图)。下面这个柱状图就是官方给的例子6 c$ Q" M# m3 d, k* F& y) ?

两个有趣的应用场景2 ^ Y1 R3 e( n b% |

两个有趣的应用场景2 ^ Y1 R3 e( n b% |

论文里提到了两个额外的应用,我觉得挺有意思。

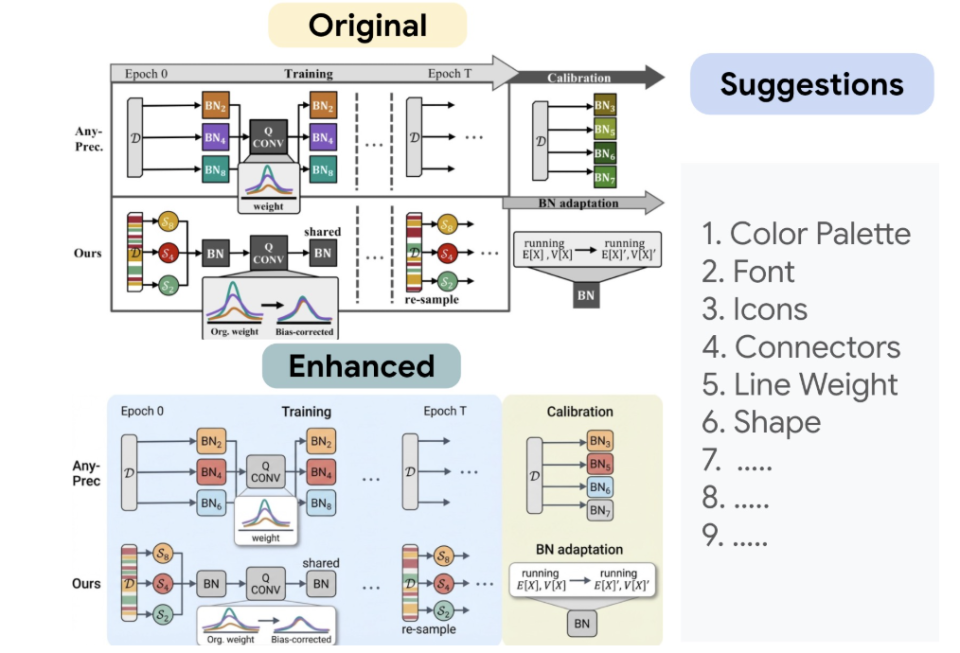

6 i) s6 ^8 O- d7 p场景一:优化人类画好的图* |% r. g: j/ Q8 m

你可能遇到过这种情况:自己画的图内容是对的,但配色、字体、布局不太专业。% v. p7 S5 s. r% s# m

PaperBanana可以先"学习"学术图表的美学规范,然后用这些规则去优化你已有的图。

g p8 c7 ]3 S+ _ F论文里有个对比示例:原始图是作者手画的,信息准确但配色有点老气。经过优化后,颜色更现代,字体更统一,整体感觉专业了很多。

! p+ B, O5 u* F8 B/ ~# d

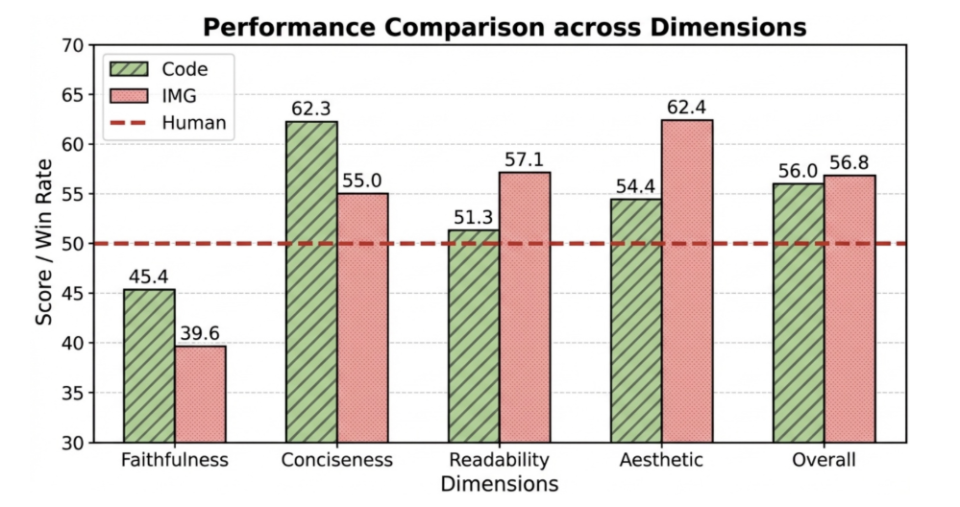

场景二:用图像生成模型画统计图

场景二:用图像生成模型画统计图

" I/ e/ v' ]$ r2 ]传统的统计图都是用代码(Matplotlib、Seaborn)生成的,优点是准确,缺点是不好看。

8 t5 V/ o4 o/ K4 D' NPaperBanana尝试用图像生成模型(比如DALL-E、Midjourney这一类)直接生成统计图。* C& @! u' N" f0 x- D

结果发现了一个有趣的trade-off:% v! w+ t6 k( m" e7 k4 R1 @

图像生成的图表更美观、更有设计感

# ?+ a+ M! B2 r' n" n$ _) h9 P$ U1 D但准确度不如代码生成,容易出现数字错误、元素重复等问题

6 ?. O) [- D3 s7 N/ J3 o4 P这个结论挺真实的。图像生成模型在"看起来好看"上很强,但在"数值准确"上确实有局限。' Y: O$ L3 q; z: L" x" g# U' ^

官方还给了对比例子,别的不多说了,大家看下哪个更好9 m& k/ i$ q* Q. s$ H) v6 h/ H8 W" q

官方还给了对比例子,别的不多说了,大家看下哪个更好9 m& k/ i$ q* Q. s$ H) v6 h/ H8 W" q

但它还做不到什么?% V( W2 `$ ~, j

但它还做不到什么?% V( W2 `$ ~, j

当然,PaperBanana也不是完美的。: U, p$ F8 n( R5 g+ B& ^% d( l

论文里坦诚地列出了主要的失败案例:连接错误。

: _: J }) O2 a- }/ ]比如该连的没连,连错目标节点,或者有多余的连线。这些问题,Critic智能体有时候也识别不出来。( r' S$ J7 m/ E2 J5 _: {9 t

初步分析认为,这可能和基础模型本身的感知能力有关——有些视觉关系,模型就是看不出来。

& d6 P" G# d0 v: K& I除此之外,还有一些现实的限制:

" p# w. b( B: ^/ ?6 P' ~4 a1 T生成速度:五个智能体串起来,一次迭代可能要几分钟。如果是复杂图表,需要多次迭代,时间成本还是有的

. T5 {% C; Y2 J; q领域限制:目前主要针对AI领域的论文,其他学科(比如生物、物理)的图表,可能需要重新训练6 P- [; D V( N9 j& k0 a

风格局限:虽然能学习参考图风格,但如果目标风格和训练数据差异太大,效果会打折- A3 t: G3 f! A9 G u5 d& ^: b3 {

所以,现在的PaperBanana更像是一个"助手",而不是"替代品"。% ]- A1 M7 {+ g' Z* C/ l: Q

它可以帮你快速生成初稿,但最终的微调、校验,还需要人来把关。 h3 f: R7 R" o7 U' K! K

题外话了,每日一感慨

5 h9 O5 z% [7 [( n6 r0 ^0 E" `PaperBanana这类工具的出现,让研究者可以把更多时间花在真正的"思考"上,而不是"制图"上。

0 m% o' C% n H; Z: z T3 I类比一下编程领域:现在有Trae、Cursor、CodeX、Claude Code这些AI编程助手,让程序员效率大大提高,很多编码都是由AI来完成了。5 Z) M Y" d$ b

PaperBanana对学术写作,可能也会起到类似的作用。

& [, {; J8 r0 M; ~- ]再往后的未来,学术研究中的很多体力活,以前需要大量人力精力的,可能都会有AI来完成。所有能够流程化,逻辑确定的内容都可以AI来搞定了!AI注定要重塑科研的工作流程!

0 M7 D4 [( k& e! y3 U# E项目仓库(还没开源,先关注下,春节后估计就放出来了)

+ Q3 _: f _" phttps://github.com/dwzhu-pku/PaperBanana4 T- U$ g1 w3 D# w$ ~7 i3 p5 `' R0 f

|

|