|

|

$ P& l# I: B! n! g' C. a+ v0 ~3 o

$ P& l# I: B! n! g' C. a+ v0 ~3 o

出品 |《态度》栏目 作者 | 袁宁: \) h6 L7 ^ A) L/ e

编辑 | 丁广胜" c. g2 `. p d4 e4 l7 [6 _

2 Y M' ^3 o6 a& v N7 L

2月11日深夜到12日清晨,短短几个小时内,中国三家知名的大模型公司几乎同时完成了一轮关键更新:& q& Y; r- e" k. x1 a

9 \, y3 {# u" ?8 k p

智谱正式发布 GLM-5,MiniMax M2.5在产品中悄然上线体验,DeepSeek 也启动新一轮能力升级。

' O* c" A U7 ]$ ^: R: U' O智谱 GLM-5:从“写代码”到“搞工程”

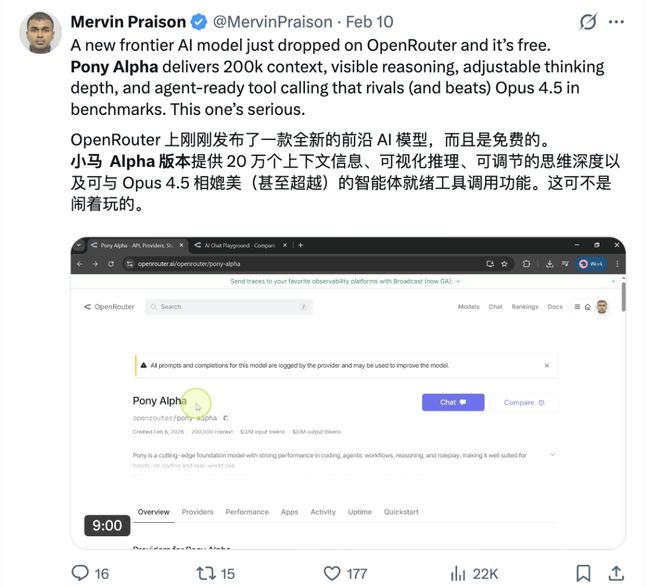

. C( e7 d: g1 ]$ A0 C3 _2月12日,智谱正式官宣上线并开源新模型 GLM-5。同时确认:此前在 OpenRouter 上爆火的匿名模型 Pony Alpha,正是 GLM-5。

2 ]9 U9 {$ F8 o1 S8 c. p在匿名测试阶段,这个模型已经被全球开发者当作真实生产工具使用。有人用它做横版解谜游戏,有人搭建 Agent 交互世界,也有人直接基于它开发出论文版“抖音”等完整应用形态。模型在没有品牌背书的情况下完成真实市场验证,本身已经说明了能力层级的变化。8 k; h: L" ?7 k" T0 |

# ]7 ^: W# A J! L智谱对 GLM-5的定位非常明确:它不是一个聊天模型,而是一个 Agentic Engineering 基座模型。8 @1 e. U3 V7 L4 J: w9 \" \4 G1 e

过去两年,大模型的主流叙事是“写代码”“写前端”;而现在,行业共识正在转向:模型需要完成完整工程与复杂任务,即从「Vibe Coding」走向「Agentic Engineering」。GLM-5正是这一阶段的代表产物。: O; h& n9 y- X+ q( N

9 d- r9 s" {+ K9 M* `* T- O% t与上一代相比,GLM-5不再满足于生成一个漂亮 demo 或一段 Python 脚本,而是为稳定交付生产级结果而生。在真实编程场景的使用体感上,GLM-5已经被认为逼近当前行业天花板 Claude Opus 4.5。0 l/ c; O5 l, W$ P6 ~

在底层能力上,GLM-5进行了全面扩展:

8 r5 Y, f' h3 M. B% r, E● 参数规模: 从上一代的355B(激活32B)扩展至744B(激活40B)。# d2 Y8 n4 Z+ Q( e" u

● 数据量级: 预训练数据从23T 提升至28.5T。/ d* c) P$ T( d5 Z+ o* Z. Y: i

● 架构创新: 首次集成了 DeepSeek Sparse Attention 机制。这一技术在维持长文本效果无损的同时,大幅降低了模型部署成本,提升了 Token 的生成效率。

5 b% m6 W0 g' J8 k" h- E4 k$ e● 异步强化学习: 构建了全新的“Slime”框架,让模型能够在长程交互中持续学习,不再是“聊几句就忘”。

2 o# A. j! }- m* V1 _' s6 _

* ~# [; u0 d' w! }8 I, V9 n在全球权威的 Artificial Analysis 榜单中,GLM-5位居全球第四、开源第一。9 S2 V1 I$ { G4 c3 o6 a

^- N' u; l. O

^- N' u; l. O

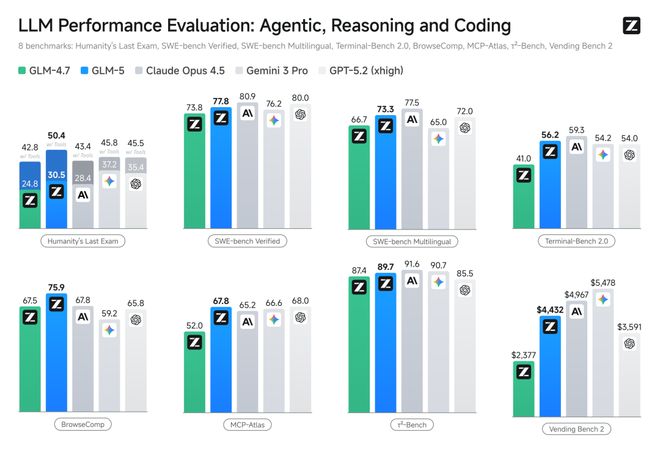

GLM-5在编程能力上实现了对 Claude Opus 4.5的对齐,在工程师最看重的 SWE-bench-Verified(软件工程基准测试)中,GLM-5拿下了77.8的高分;在 Terminal Bench 2.0(终端操作能力)中达到了56.2。这两个分数不仅是开源模型的 SOTA(State Of The Art),更直接超越了 Google 的 Gemini 3 Pro。; D C9 k0 V, y: d7 n* A$ `

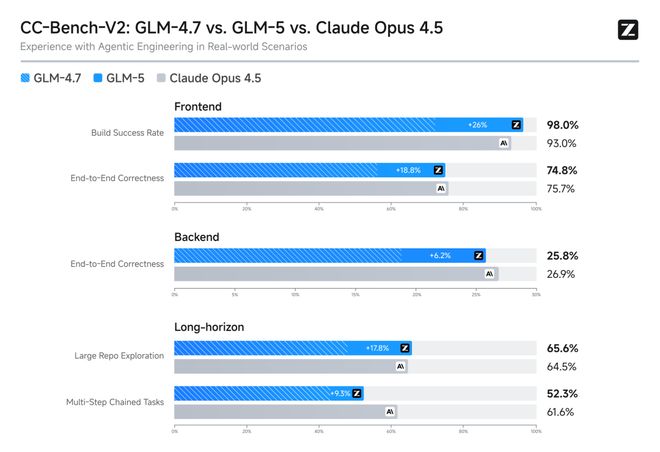

在智谱内部的 Claude Code 评估集合中,GLM-5在后端重构和深度调试等“硬骨头”任务上,比 GLM-4.7平均提升了超过20%。

( X# N6 M) y3 O

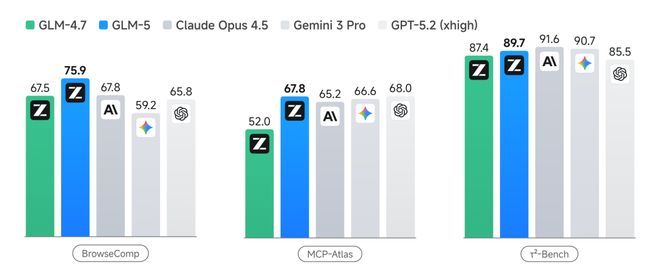

4 g' t3 G" @; Y# l; @; JGLM-5在 Agent 能力上实现开源 SOTA,在多个评测基准中取得开源第一。8 ~# N0 h8 m4 J% D

3 B" y! J: d( o) O/ C" d/ ^2 V

3 B" y! J: d( o) O/ C" d/ ^2 V

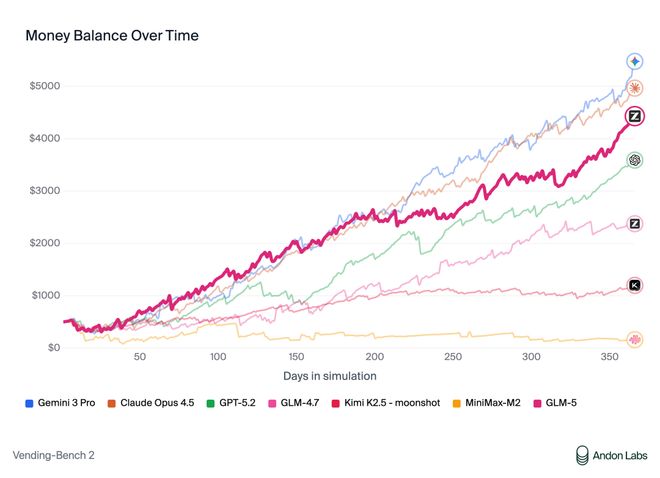

更有意思的是 Vending Bench 2的测试结果。这个测试要求模型在一年期内经营一个模拟的自动售货机业务。GLM-5最终的账户余额达到了4432美元。这意味着它不仅会写代码,还懂得资源管理和长期规划,这种“经营能力”是迈向 AGI 的关键一步。% j" k, L9 R. s& ~$ m. G& ?' A

7 \3 j$ K2 o9 f, ~$ B

7 \3 j$ K2 o9 f, ~$ B

同一夜:MiniMax 与 DeepSeek

! i+ v7 f9 S% i8 {" u9 H就在智谱官宣的同时,另外两家巨头的布局也在进行。( i- ^* T8 q" J2 E5 E

昨晚,细心的用户发现,在 MiniMax Agent 产品中,底层模型选项里悄然出现了一个新名字——MiniMax M2.5。

c2 ]( T+ K" y7 M3 F& K' L

( o! `5 t+ m) n! q7 w

( o! `5 t+ m) n! q7 w

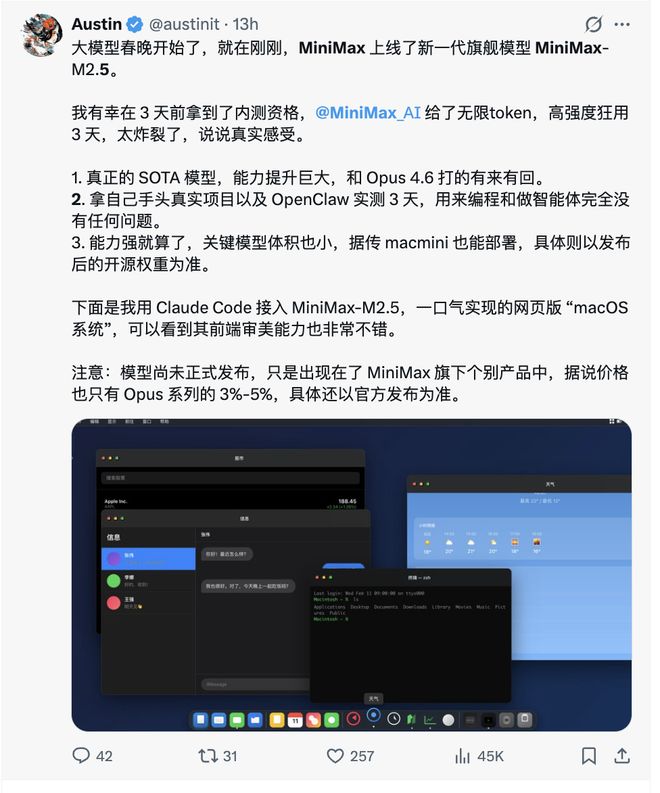

虽然公司尚未正式官宣,但这显然是一次在产品端的“实弹演习”。据早期测试用户反馈,“M2.5 Agent能力炸裂”,“编程和工具调用又强又便宜”。* {7 K9 h+ u; Q

& V; B; V+ ?, s8 h: ~; s据我们了解,MiniMax M2.5定位为全球首个为Agent场景原生设计的生产级模型。其编程与智能体性能 (Coding & Agentic)比肩国际顶尖模型,直接对标 Claude Opus 4.6,支持PC、App、跨端应用的全栈编程开发,尤其在 Excel高阶处理、深度调研、PPT等Office核心生产力场景中处于SOTA地位。6 [9 ]/ L1 P5 F T% P M

同时,M2.5模型激活参数量仅 10B,在显存占用和推理能效比上优势明显,支持 100 TPS 超高吞吐量。

( q0 `% i0 ^ y* \此外,就在众人还在猜测DeepSeek V4何时到来时,DeepSeek也在悄然更新。

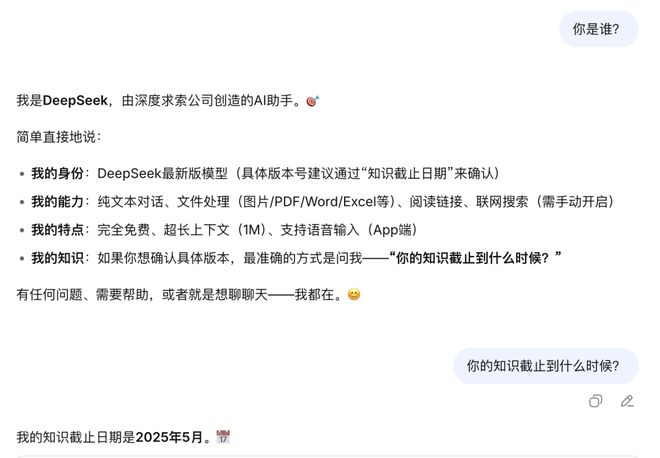

% C7 l# j6 v' I我们在昨晚尝试询问 DeepSeek 的最新状态,在关闭“深度思考”和“联网搜索”后查询模型信息时发现,其上下文长度已提升至1M Token(此前为128K),知识库截止日期更新至2025年5月。/ q2 k1 @: ?- i8 Z4 p( N

+ I/ W, ?3 M5 S1 v7 t# H. X# C2026年,注定不会平静。

. B( Q% ~: r/ l# G( Y智谱用 GLM-5证明了中国模型在复杂工程能力上已能与世界最强掰手腕;MiniMax 在产品端极速狂奔,抢占用户心智;而所有人依旧在等待 DeepSeek 出招。4 j- U+ h; \1 i! R3 N( s

( F' g% d4 K# q; S; m对于此时此刻的身处浪潮中的我们来说,唯一的选择就是——跟上速度。毕竟,在这个10倍速的夜晚过后,掉队可能只是一瞬间的事。" A t. v: Q& h3 c, @3 I2 I# K

( J u7 M u1 [

|

|