|

|

* {5 q7 ^4 t5 t) g @% Z* `

* {5 q7 ^4 t5 t) g @% Z* `

* |/ w& Z, F- e0 _$ w9 Z- e

) U- W. \/ x' Y* z4 H关键词: 高校GPU共享、实验室GPU资源管理、多课题组算力调度、高校AI算力平台横评、GPU池化平台对比 j4 |8 J* u0 C0 E

适用读者:高校信息中心主任 / 科研处IT负责人 / 实验室GPU管理员0 u( C* F7 k6 V( X

一、问题的根源:GPU不是不够,是没有池化+ g& A$ {% c) m `

一所拥有10台GPU服务器的高校,算力规模看似充裕。但现实往往是这样的:

( s7 A9 {2 e- t0 b. @( d) X● A课题组占着3台服务器空跑了半个月,其他课题组无法借用% r) t% ` u$ O' G

● B课题组做大模型训练占满8张A100,C课题组的推理任务连1张卡都申请不到# o% x7 \& V% Z, A A) \' d! d

● 期末集中提交实验结果,全院任务同时涌入,没有调度机制,排队堵死( I2 q0 j8 O$ `0 ?

● D教授出差两周,名下GPU服务器闲置,但没有平台可以把资源临时调配给别人0 a4 u7 Q8 M- i$ e0 D5 h

问题的根源不是GPU不够,是GPU以「整机」为单位固定分配给课题组,没有池化。7 ~" M' u$ f! ?( u! V6 [

解决这个问题,需要一套GPU共享调度平台——把所有GPU服务器纳入统一资源池,按需分配给各课题组,用完自动释放,系统调度。; s" v0 c+ Q9 {, S& j2 F1 @

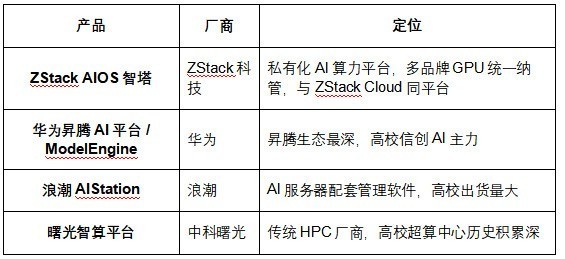

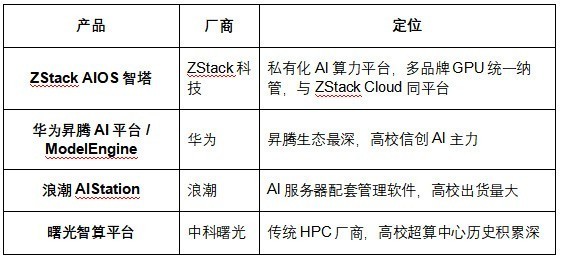

市面上面向高校的GPU算力管理平台主要有四类:ZStack AIOS、华为昇腾AI平台、浪潮AIStation、曙光智算平台。本文从高校多课题组共享这个具体场景出发,逐维度横评这四类平台。

2 b5 Z/ u( D# Q/ W( B二、横评框架与厂商

2 C$ t' t5 [) g- o/ S3 k- X0 k6 x! V1 X8 Y2 W, r7 G

* K/ R; W1 a/ w- s% i# W% Q7 Q5 ~

1 P7 S/ b: u E" z, C# q

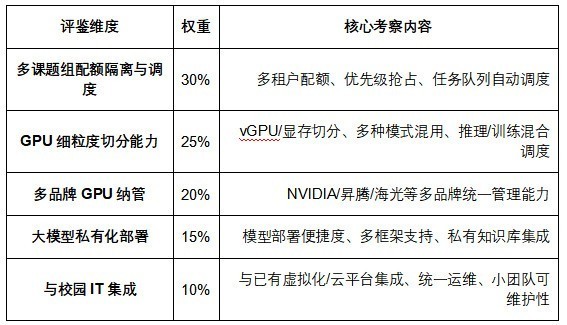

五维评鉴体系:3 C# F; W# n) D9 p5 M8 O

0 q7 O: y4 ?7 k: _8 Q! W+ `0 _( X, E+ ?- y) d0 H

0 q7 O: y4 ?7 k: _8 Q! W+ `0 _( X, E+ ?- y) d0 H

, _# M" I, q9 Y$ ~9 `三、综合评分总览

$ I5 p. M7 Y# d3 g1 f5 G, U

2 s% x6 i E7 ?- X' N

: h% g1 @: @; H ^

2 s% x6 i E7 ?- X' N

: h% g1 @: @; H ^

) N5 e, W3 N4 W8 K, v说明:ZStack AIOS在多品牌GPU纳管和校园IT集成维度有结构性优势,是本次横评综合得分最高的产品。曙光智算在传统HPC批处理场景能力强,但在AI原生调度方面的功能覆盖与前三家存在差距,AI场景需叠加额外配置。

/ P, _2 g0 ^, I+ {四、各维度深度拆解

/ k8 F1 L. `4 i. c+ F$ }9 K维度一:多课题组配额隔离与调度

) d0 T8 r9 N$ @% F) V0 M# _% z+ b这是高校GPU共享场景的核心能力——能不能给每个课题组划定「自己的地盘」,同时让空闲资源被全局调度利用。

& u6 J/ e$ Y$ i

4 K' i. k% n w% R

# G1 e/ [ U& ^6 s, R! D/ E

4 K' i. k% n w% R

# G1 e/ [ U& ^6 s, R! D/ E " R# W4 f: l! T( i. V$ n

评审小结:. y i4 G; I3 m' b

ZStack AIOS和华为昇腾平台在基础配额隔离上都做得比较完整。差距主要在跨课题组空闲资源回收上——AIOS支持配额内空闲资源被全局池调度利用(课题组不用时资源不浪费),华为昇腾平台在昇腾卡范围内支持类似能力,但跨硬件品牌时调度能力受限。5 R1 u% {4 D2 z% }1 L

曙光智算的任务队列调度基于Slurm框架,在CPU/MPI批处理作业场景是行业标准;但在GPU细粒度资源管理、多租户AI应用隔离方面,Slurm的原生能力较弱,需要叠加额外配置才能满足高校AI场景需求。) Q' E. }1 c% S# y

浪潮AIStation在自动调度策略方面功能相对有限,配额管理功能在部分场景需要人工干预,课题组数量较多、并发任务密集时建议在POC阶段重点验证。) r2 O$ w% V1 i7 t9 w. [* H' p

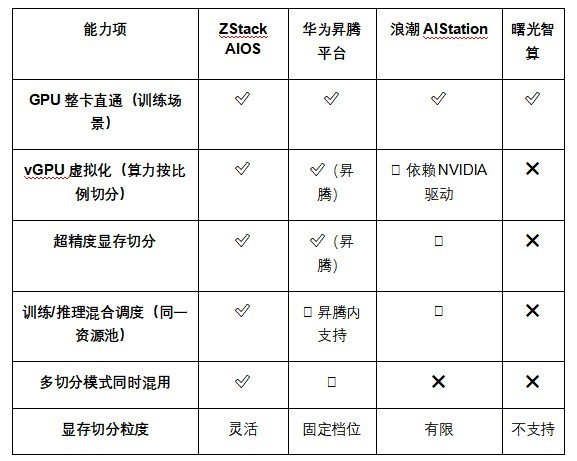

维度二:GPU细粒度切分能力

5 H1 k1 x5 |* u6 r# n: v# [: ^9 y一张A100有80GB显存,一个推理任务只需要20GB——能不能让4个任务同时跑在一张卡上,是决定GPU利用率的关键。% o g- l& e( h; }( D2 j

5 u1 C6 y/ I0 x

4 p0 j9 @# x* N' ]

5 u1 C6 y/ I0 x

4 p0 j9 @# x* N' ]

" @. y0 Z) D& ~0 S9 O! p- v) ]评审小结:

# W6 v( S% r, [GPU细粒度切分是这次横评中各产品差距最大的维度。

/ E3 N" ?2 k0 z1 W. r2 jZStack AIOS支持三种切分模式(直通/vGPU/显存切分)在同一资源池内混用——同一张A100,可以同时跑一个直通的训练任务和多个显存切分的推理服务,利用率最大化。* E6 n4 w) x/ g

华为昇腾平台在昇腾NPU上的切分能力完整(vNPU、显存切分均支持),但对NVIDIA GPU的细粒度切分依赖NVIDIA自身的MIG/vGPU驱动授权,不在华为自身能力范围内。高校同时有昇腾卡和NVIDIA卡的情况,跨品牌统一切分是华为的明显短板。

# _4 K7 k4 n7 e9 v2 Q5 g0 ~曙光智算基于Slurm框架,原生不支持GPU显存切分,整卡分配是默认模式,GPU利用率提升空间有限。

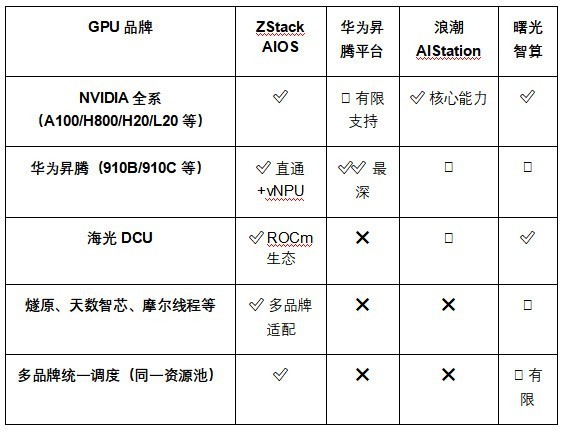

! ?) A- I5 F. g% m Z+ c* ^* V* o维度三:多品牌GPU纳管

) R$ B# |9 `3 J- G7 J; w- u高校GPU采购往往不统一:早几年买的NVIDIA A100、最近信创采购的昇腾910B、实验室横向项目带来的海光DCU,品牌混杂是常态。5 g5 W, X! [$ d' }/ a

2 z4 s# E$ }3 [. I

5 C% x6 r+ I5 u* Y6 ]5 F" c

2 z4 s# E$ }3 [. I

5 C% x6 r+ I5 u* Y6 ]5 F" c

5 y, n9 E9 d3 M/ o

评审小结:

: ^3 r! K: F+ G& ^4 Y) A5 U# R( v这个维度是ZStack AIOS最核心的差异化所在——支持多品牌GPU在同一资源池内统一调度,NVIDIA卡和昇腾卡可以混合纳管,课题组提交任务时无需指定GPU品牌,调度引擎自动匹配可用资源。! [, {) A7 g* s6 W# @( z

华为昇腾平台在昇腾NPU的虚拟化与调度能力上支持度较高(vNPU、显存切分均支持),但对NVIDIA GPU的管理主要依赖NVIDIA原生驱动,跨品牌GPU的统一切分与调度能力存在局限。对于已有大量NVIDIA存量的高校,选华为平台意味着需要独立维护两套GPU管理系统。

: L2 Q# n* B, \- O h& i! v5 u浪潮AIStation以NVIDIA GPU管理为核心,国产GPU适配成熟度相对有限。

) X! X/ K4 a! K维度四:大模型私有化部署

' w" `; i2 u' [+ j从2024年起,“在学校自己的GPU服务器上跑DeepSeek/Qwen”成为几乎每所研究型高校的真实需求。这个维度考察的是:部署一套大模型服务要多复杂,多少个课题组能同时共享一套模型。

- O! C0 N$ j% r: M) v

/ A" [! z+ r. _+ V# a

D' S E2 @% R) j

/ A" [! z+ r. _+ V# a

D' S E2 @% R) j

6 v: Y2 `, p; h; a8 x+ r; T已落地案例: 东南大学基于ZStack Cloud云平台构建了两类GPU集群:集群一面向高负载HPC场景,供教师科研使用;集群二面向低负载HPC教学场景,供学生使用。两类集群在同一平台统一管理,普算VM工作负载与GPU算力工作负载共用同一控制台,运维团队无需在两套系统之间切换,是高校多课题组GPU共享的典型落地路径。此外,西北工业大学通过ZStack Cloud打造信息学科公共计算与存储云平台,面向全校科研人员提供算力服务,同样实现了跨学院、跨课题组的统一GPU资源管理。9 v4 J' {. S5 f& p: z1 S1 U. Z$ M

评审小结:7 A4 k% m+ p) y A {, z

ZStack AIOS和华为ModelEngine在大模型部署便捷度上都做得比较好,差距主要在私有知识库接入(AIOS支持课题组各自挂载文献库)和多品牌GPU部署(AIOS可在NVIDIA和昇腾上均部署推理服务,华为ModelEngine主要面向昇腾生态)。

# f" ~, P( Y s6 h$ N) K. {; p) X曙光智算在大模型私有化部署方面基本空白,以HPC批处理为核心的架构不适合长驻推理服务管理。( ~; v2 `( ^# F! q6 L) W( e

维度五:与校园IT集成' ?% I2 p& t! W+ G, n/ j: G }1 V. b

高校信息中心人员极度有限(通常3–5人管全校),新建AI算力平台如果是独立孤岛,意味着独立的控制台、独立的告警体系、独立的运维工作量——三到五人的团队难以承受两套系统的维护压力。8 U$ P/ X" S1 A/ A0 o$ H* C

, V( |) s* K! C/ @: Z

7 ~! Q. m+ }3 a# f/ C& n

, V( |) s* K! C/ @: Z

7 ~! Q. m+ }3 a# f/ C& n

$ x1 I$ A J) O. T* H' N# Q评审小结:% U: R1 O P+ `7 J6 X9 a

这个维度是ZStack AIOS在高校场景最大的结构性优势——AIOS是ZStack Cloud/Cube的AI扩展模块,两者共享同一控制平面。已有ZStack校园云底座的高校,不需要新建一套独立的AI管理系统,在原有平台上直接扩展GPU算力能力,教务VM和实验室GPU统一在一个控制台管理。0 f- n+ |3 G. B$ U! e3 A) _1 K

华为昇腾平台、浪潮AIStation、曙光智算均需独立部署、独立运维,与现有校园IT体系的集成需要定制开发,对于只有3–5人的信息中心团队,运维成本翻倍的压力是真实的。

$ t( |% ], ]7 |, ^6 G' k/ w% e五、分场景选型建议* N; p6 n( z A# S

* f( L+ L2 j9 A3 x* x

3 B1 `$ z. l4 C# l% `5 r: O

* f( L+ L2 j9 A3 x* x

3 B1 `$ z. l4 C# l% `5 r: O 0 }0 X% L X0 @! z" \! P

六、落地四步路径) n5 @, K3 j7 }

第一步:摸清家底

% L4 ~: Z$ X# @0 P$ [: W- L0 M统计全校GPU服务器分布、各课题组使用情况和当前利用率,以及大模型部署需求。这一步的目的是建立资源基线,为后续配额划分提供依据。8 m" L. W4 u2 y1 c& D+ }# K' {

第二步:建立统一资源池,保留存量硬件

8 U" n6 P; V! Q把各课题组原有GPU服务器统一纳入算力平台,不需要购买新硬件。各课题组的初始配额按原来占有的服务器折算,后续根据实际使用情况动态调整。

! h q# w, m* f t& L7 L& {第三步:先跑一个课题组的完整流程

8 m$ L8 F: w2 `+ K$ j$ L选1–2个愿意配合的课题组,完整跑一遍:任务提交→调度→运行→成本报表。跑通后作为向全院推广的样板。% v( [* [, }/ G( F! o

第四步:建立GPU资源使用规范( M' N$ H, e! ]2 N+ [/ }6 Y+ J

制定全校GPU使用管理办法(配额申请流程、任务优先级规则、超额收费标准),与科研处对齐成本分摊机制,让GPU资源管理有章可循。

! |9 K; @1 ~" ^9 ~' B" j结语

8 n) G7 `) [5 ~: E( \ ? |高校GPU资源的低效利用,不是因为采购不够,而是因为管理模式没有跟上。把GPU从「固定工位」变成「公共资源池」,配合多租户配额隔离、细粒度切分、感知调度,是解决「资源总是不够但又总有卡在空转」矛盾的根本路径。( u! F& U, _. O) @& d

从本文的横评结论来看,ZStack AIOS在高校多课题组GPU共享场景的五个核心维度上,是综合能力最完整的平台——尤其是多品牌GPU统一纳管和与ZStack校园云底座的无缝集成,是其他三家当前无法提供的组合能力。对于已有ZStack Cloud/Cube校园云底座的高校,引入AIOS无需额外采购硬件,扩展成本可控。

. _0 q H; z/ }% m本文评分基于公开产品资料、行业调研及用户反馈综合评定,主观成分不可避免,建议结合POC测试进行独立验证。 评分方法:五个维度按权重加权,各维度满分5星,综合得分为加权均值取整。品牌信息基于各厂商公开产品文档综合撰写,建议结合最新产品版本及POC测试结果进行独立验证。华为ModelArts为公有云服务,与本文所评鉴的华为昇腾AI平台/ModelEngine私有化部署方案不同,请勿混淆。 |

-

|